Dr. Melchor Sánchez Mendiola

Coordinador de Evaluación, Innovación y Desarrollo Educativos, UNAM

Introducción

La certificación de especialistas es un componente esencial de la confianza pública en la medicina. En México, la certificación y la recertificación se apoyan en procesos evaluativos que buscan sustentar, de manera defendible, que una persona cuenta con competencias profesionales para ejercer una especialidad con seguridad y calidad. Para los Consejos de Especialidades, la evaluación es el mecanismo principal para tomar decisiones como otorgar la certificación, mantenerla mediante recertificación, y establecer rutas de retroalimentación.

La práctica clínica especializada, sin embargo, es multidimensional. Integra conocimientos biomédicos y clínicos, razonamiento y toma de decisiones bajo incertidumbre; habilidades técnicas, comunicación, profesionalismo, colaboración interprofesional, y desempeño en sistemas de salud reales. Ningún instrumento aislado captura toda esa complejidad. Por ello, los exámenes de certificación deben concebirse como parte de un sistema de evaluación más amplio y, al mismo tiempo, deben ser diseñados y defendidos con un estándar particularmente alto: los errores o sesgos en la medición tienen consecuencias personales, institucionales y sociales.

En este marco, la validez es el concepto rector. Hablar de validez implica responder una pregunta central: ¿qué significan los puntajes obtenidos y qué tan apropiado es utilizarlos para la decisión prevista, en un contexto específico? En evaluaciones de alto impacto, no basta con reportar un coeficiente de confiabilidad o un conjunto de estadísticas globales; se requiere un argumento estructurado que conecte el desempeño observado en el examen con la competencia profesional que se pretende inferir, y que considere explícitamente el impacto y la equidad de las decisiones. La literatura reciente en medición educativa y en educación de profesiones de la salud ha enfatizado esta perspectiva argumentativa y dinámica de la validez.1,2,3

¿Qué significa validez en evaluación?

En su sentido contemporáneo, la validez se entiende como la solidez del argumento que respalda la interpretación de los puntajes y el uso de los resultados. Esta formulación tiene implicaciones prácticas importantes para los exámenes de certificación.

Primero, la validez no es una propiedad “intrínseca” del examen en abstracto. Se atribuye a interpretaciones y decisiones concretas. El mismo instrumento puede ser aceptable para un propósito formativo (retroalimentar fortalezas y áreas de mejora) y, a la vez, ser insuficiente para una decisión sumativa de certificación si no ofrece precisión adecuada alrededor del punto de corte, si no cubre el dominio de práctica con representatividad, o si genera consecuencias no deseadas.

Segundo, la validez se construye como un argumento.

- El desempeño del sustentante en las tareas del examen

- El puntaje y su precisión

- La generalización del puntaje a un universo más amplio de contenidos o casos

- La extrapolación del desempeño del examen a la práctica clínica

- La decisión institucional derivada (por ejemplo, certificar o no certificar).

Cada inferencia descansa en supuestos, y cada supuesto puede ser respaldado o cuestionado con evidencia.

Tercero, la validez es dinámica. La práctica clínica cambia, los programas formativos evolucionan, aparecen nuevas guías y tecnologías, y las modalidades de examen se transforman (por ejemplo, migración a plataformas digitales). Por ello, la validación debe entenderse como vigilancia y mejora continua, no como un evento único que, una vez completado, permita considerar al examen como “validado para siempre”.2

Del instrumento al argumento de interpretación‑uso

Un enfoque particularmente útil para ordenar la validación es el argumento de interpretación‑uso (Interpretation‑Use Argument, IUA).4 Este enfoque desplaza la conversación de “defender el examen” a “defender la decisión” y obliga a que el propósito sea explícito.

En términos operativos, el IUA comienza con una definición precisa de:

- El propósito del examen (certificación inicial, recertificación, evaluación de componentes específicos)

- La población objetivo y condiciones de elegibilidad

- El constructo o conjunto de constructos que se pretende evaluar

- El universo de contenido o especificaciones del examen (blueprint)

- El tipo de interpretación del puntaje (global, por dominios, perfiles)

- El uso previsto (decisión dicotómica, niveles de desempeño, recomendaciones)

- Las consecuencias esperadas y no esperadas.

La utilidad del IUA es doble. Por un lado, orienta la recolección de evidencias: no todas las evidencias son igual de relevantes para todas las decisiones. Por otro lado, permite que la comunidad y los comités técnicos critiquen supuestos de manera transparente, lo que fortalece la legitimidad social del proceso.

En educación de profesiones de la salud se ha señalado que, en la práctica, conviven múltiples marcos para organizar la validez y que es frecuente que la terminología se use de manera imprecisa, generando confusión. De ahí la importancia de “tender puentes” entre marcos: alinear fuentes de evidencia con inferencias del argumento, y emplear un lenguaje consistente que facilite la comunicación entre expertos, comités de examen, autoridades y la comunidad médica.

Fuentes de evidencia para sustentar interpretaciones y decisiones en certificación

En la práctica, un argumento de validez se construye con evidencias provenientes de distintas fuentes. A continuación, se describen las más relevantes para exámenes de certificación de especialidades médicas, con ejemplos operativos.

1) Evidencia basada en contenido y diseño del examen

El núcleo de un examen de certificación es su alineación con el dominio profesional. Esto requiere definir un marco de referencia que represente la práctica: perfil de egreso o de desempeño esperado, funciones profesionales, problemas prioritarios, ámbitos de atención y nivel de complejidad.

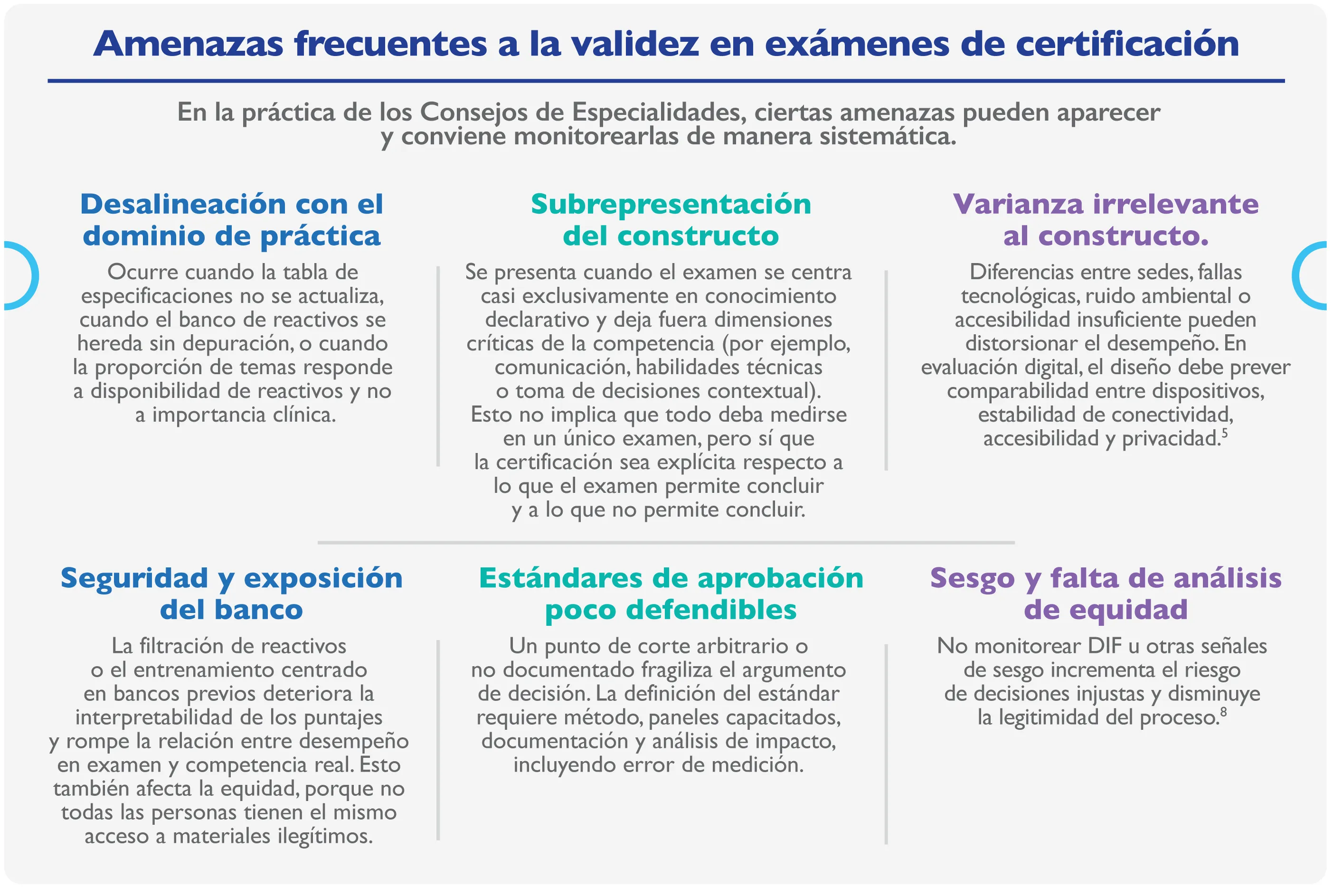

A nivel operativo, este marco se traduce en una tabla de especificaciones o blueprint. Esta tabla defendible define dominios y subdominios, proporciones justificadas, niveles cognitivos, tipos de casos y criterios de actualización. Además, permite trazabilidad: cada reactivo debe poder mapearse a un elemento de la tabla. La trazabilidad es clave para transparencia, para auditoría interna y para demostrar que el examen no depende de la disponibilidad azarosa de reactivos.

La evidencia de contenido se fortalece con procesos de revisión estructurados: paneles de expertos con representatividad, procedimientos formales para consenso, criterios explícitos para pertinencia clínica y políticas para manejo de conflictos de interés. En evaluación digital, las guías internacionales recomiendan considerar accesibilidad, comparabilidad, seguridad y privacidad como requisitos integrales de calidad.5

2) Evidencia basada en procesos de respuesta

Los puntajes son interpretables solo si las tareas del examen inducen los procesos cognitivos y clínicos que desean evaluarse. En reactivos de selección, interesa saber si el sustentante responde por razonamiento clínico y no por pistas superficiales. En exámenes orales o estaciones, interesa que la rúbrica sea entendida y aplicada de manera consistente y que las preguntas no se desvíen hacia contenidos irrelevantes o hacia estilos personales del evaluador.

Esta evidencia puede construirse mediante entrevistas cognitivas en pilotaje, análisis de “pensamiento en voz alta”, revisión de distractores, auditorías de calidad editorial y capacitación con calibración de evaluadores. En modalidades en línea, también puede incluir evidencia de que la interfaz y la experiencia del usuario no introducen carga cognitiva irrelevante que distorsione el desempeño.5

3) Evidencia basada en estructura interna y control de error de medición

La estructura interna se refiere a cómo se comportan los reactivos o estaciones como conjunto y a cuánta varianza del puntaje puede atribuirse al constructo y no al error. En exámenes escritos, suele incluir consistencia interna, análisis de dificultad y discriminación, funcionamiento de distractores, modelos de teoría de respuesta al ítem, y estimaciones de error estándar de medición (idealmente alrededor del punto de corte). En exámenes con evaluadores, se agregan concordancia interevaluador, modelos de generalizabilidad para descomponer fuentes de variación (casos, evaluadores, estaciones), y análisis de severidad o leniencia.

En decisiones de certificación, la pregunta práctica es: ¿qué tan probable es que una persona cambie de categoría (aprobado/no aprobado) si se repitiera el examen con una forma equivalente? Esta pregunta es más informativa que un coeficiente global aislado.

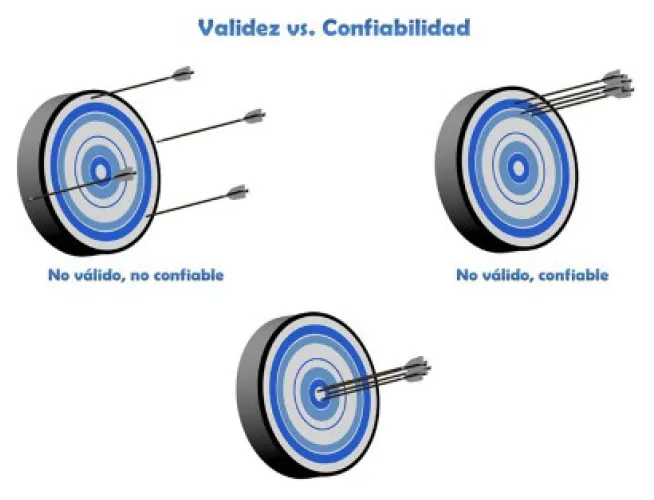

La siguiente imagen presenta la analogía de blancos de tiro para ilustrar la relación entre validez y confiabilidad: los tiros agrupados reflejan precisión (confiabilidad), mientras que la cercanía al centro refleja acierto respecto al constructo (validez). La certificación requiere ambas condiciones.6

4) Evidencia basada en relaciones con otras variables

Si el examen pretende representar competencia profesional, se esperan relaciones coherentes con variables externas, como desempeño en entrenamiento, evaluaciones en el trabajo, resultados en exámenes previos o participación en programas acreditados. Estas asociaciones rara vez son perfectas, porque los instrumentos miden dimensiones distintas, pero su patrón debe ser teóricamente razonable.

Un ejemplo reciente en certificación describe cómo un examen de subespecialidad organizó evidencias en múltiples fuentes, incluyendo asociaciones entre completar entrenamiento acreditado y aprobar el examen, además de alta consistencia interna, para sustentar decisiones sumativas.7

5) Evidencia basada en consecuencias, equidad y responsabilidad social

En evaluaciones de alto impacto, las consecuencias son parte constitutiva de la validez. La equidad requiere analizar accesibilidad (que las condiciones del examen no introduzcan barreras irrelevantes) y ausencia razonable de sesgo sistemático.

El análisis de funcionamiento diferencial de ítems (DIF) es una herramienta para identificar reactivos que podrían favorecer o perjudicar a subgrupos, una vez controlado el nivel de habilidad. Un estudio con reactivos del USMLE Step 1 muestra cómo el DIF puede combinarse con revisión cualitativa por expertos para investigar sesgos potenciales y fortalecer decisiones justas.8

Más allá de la psicometría, la literatura reciente subraya que la confianza social en la certificación depende de procesos legítimos, transparentes y orientados al bien público; por ello, consecuencias e impacto social deben integrarse al núcleo del argumento de validez. (Kinnear et al., 2024).9

Confiabilidad como componente de la validez

En la práctica médica, la confiabilidad suele resumirse en un coeficiente (por ejemplo, alfa de Cronbach). Sin embargo, en certificación es más útil pensar en precisión del puntaje y en error estándar de medición, particularmente cerca del punto de corte. Un coeficiente alto puede coexistir con interpretaciones problemáticas si el examen mide un constructo incompleto o irrelevante, si el contenido no representa la práctica, o si el formato favorece estrategias que no se relacionan con la competencia clínica. Por el contrario, un examen con contenido excelente puede producir decisiones débiles si el error de medición es grande alrededor del estándar. De ahí que la confiabilidad sea necesaria pero no suficiente: forma parte del argumento de validez, pero no lo sustituye.

En instrumentos con evaluadores (exámenes orales, estaciones clínicas, procedimientos), la variabilidad entre evaluadores y casos es una fuente principal de error. La literatura reciente sobre exámenes orales virtuales destaca la necesidad de estandarización y evidencia temprana de consistencia y validez, precisamente porque decisiones de certificación no pueden descansar en juicios idiosincráticos.10

Recomendaciones operativas para Consejos de Especialidades

A continuación, se proponen acciones concretas para fortalecer el argumento de validez, organizadas como un conjunto de prácticas factibles y escalables.

- Documentar el argumento de interpretación‑uso como referencia institucional.

Cada Consejo debería contar con un documento rector que establezca propósito, población, constructo, tabla de especificaciones o blueprint, tipo de decisiones y consecuencias previstas. Este documento debe guiar qué evidencias se recolectan y debe revisarse periódicamente. La literatura subraya que un IUA bien planteado permite crítica informada y guía la recolección sistemática de evidencias.3 - Mantener una tabla de especificaciones viva, trazable y defendible.

La tabla debe actualizarse con periodicidad definida y con participación representativa. Debe existir trazabilidad entre reactivos y la tabla, y criterios explícitos para incorporar cambios en guías clínicas, tecnologías y epidemiología. - Fortalecer la gobernanza del banco de reactivos.

La calidad del examen depende del banco. Se recomiendan ciclos regulares de revisión, retiro de reactivos expuestos o con mal funcionamiento, pilotaje cuando sea posible y capacitación sistemática de redactores. La consistencia editorial reduce varianza irrelevante y mejora equidad. - Establecer un paquete estándar de análisis post‑examen.

Se sugiere definir un conjunto mínimo de análisis: dificultad y discriminación, funcionamiento de distractores, consistencia interna, error estándar y desempeño por dominios de la tabla. Para decisiones de alto impacto, es recomendable analizar precisión alrededor del punto de corte. - Incorporar equidad y consecuencias como componentes explícitos de la validación.

Además de comparar promedios entre grupos, conviene implementar análisis de DIF y revisión cualitativa de reactivos señalados, así como auditorías de accesibilidad y adaptaciones razonables.5,8 La validez contemporánea en evaluación médica enfatiza consecuencias, impacto social y equidad como parte del núcleo del argumento.9 - Diseñar estrategias de seguridad proporcionales al riesgo.

La seguridad debe preservar el significado de los puntajes. Se recomienda combinar controles de acceso, proctoring, rotación de formas, análisis de patrones anómalos y políticas claras de integridad. La seguridad no es un fin en sí mismo; es un medio para proteger inferencias y justicia. - Integrar evidencias externas cuando sea factible.

Asociaciones con entrenamiento acreditado, desempeño en formación o medidas externas aportan coherencia al argumento. La experiencia de algunos Consejos y organismos certificadores muestra que es posible documentar múltiples fuentes de evidencia de manera sistemática.7 - Prepararse para retos emergentes: evaluación digital e inteligencia artificial.

La digitalización y el uso de herramientas de IA (para generar reactivos, apoyar calificación o analizar desempeño) exigen ampliar el argumento de validez. La IA puede introducir opacidad, sesgos algorítmicos o desplazamientos del constructo. La literatura reciente advierte que cuando la validez “se encuentra” con la IA, se requieren nuevas formas de evidencia y gobernanza, con transparencia sobre modelos, datos y criterios, y con supervisión humana robusta.11

Retos emergentes: digitalización, inteligencia artificial y validez

La migración a plataformas digitales y el surgimiento de sistemas de inteligencia artificial generativa, han modificado el panorama de las evaluaciones de alto impacto. Estos cambios afectan la validez de al menos tres maneras. En primer lugar, modifican las condiciones de administración: conectividad, dispositivos, interfaces, supervisión (proctoring) y privacidad. Si estas condiciones introducen carga irrelevante o barreras, el significado del puntaje puede cambiar. Las guías internacionales para evaluación basada en tecnología ofrecen un marco para gestionar estos riesgos con foco en accesibilidad, seguridad, comparabilidad y protección de datos.5

En segundo lugar, la IA puede utilizarse para tareas del ciclo de evaluación (redacción de reactivos, generación de casos, calificación automatizada, análisis predictivo). Esto abre oportunidades, pero también introduce amenazas: sesgos aprendidos por modelos, errores difíciles de auditar, y una tendencia a delegar decisiones técnicas sin transparencia. La recomendación contemporánea es tratar la IA como un componente que debe ser validado en su propio derecho y cuyo impacto debe incorporarse al argumento de validez, en lugar de asumir que “automatizar” equivale a mejorar calidad.11

En tercer lugar, la IA cambia el ecosistema de seguridad e integridad: facilita la generación de materiales de preparación, la reproducción de estilos de reactivos y potencialmente el fraude. Esto obliga a rediseñar estrategias de seguridad, pero también a revisar el diseño de tareas de evaluación para que el desempeño refleje comprensión y juicio clínico y no solo acceso a respuestas. El desafío no se resuelve con vigilancia exclusiva; requiere rediseño, gobernanza y una conceptualización actualizada del constructo evaluado.9

Conclusiones

La certificación médica exige evaluaciones técnicamente sólidas y socialmente responsables. La validez, entendida como un argumento que sustenta interpretaciones y usos de puntajes, ofrece el marco integrador para alcanzar ese estándar. Para los Consejos de Especialidades Médicas, fortalecer la validez implica explicitar propósitos y constructos, diseñar y actualizar tablas de especificaciones; gobernar bancos de reactivos, monitorear estructura interna y error de medición; incorporar equidad y consecuencias al centro del análisis y adaptarse a retos emergentes como la digitalización y la inteligencia artificial. El resultado esperado es doble: decisiones más defendibles y, sobre todo, mayor confianza de la comunidad médica y de la sociedad en los procesos de certificación.

Referencias bibliográficas

- 1. Carrillo-Avalos B, Leenen I, Trejo-Mejía J, Sánchez-Mendiola M. Bridging validity frameworks in assessment. Teaching and Learning in Medicine, 2025;37(2):229-238.

- 2. Russell M. Clarifying the terminology of validity and the investigative stages of validation. Educational Measurement, 2022;41(2):25-35.

- 3. Raymond J, Schuwirth L, van der Vleuten CM, Heeneman S. The interpretation-use argument. Advances in Health Sciences Education, 2025;30:1313-1332.

- 4. Dai W, Vu T, Knoch U, Lim S, Malone T, Mak V. Expanding Kane’s argument-based validity framework. Medical Education, 2024;58(12):1462-1468.

- 5. International Test Commission, Association of Test Publishers. Guidelines for technology-based assessment. 2022.

- 6. Sánchez-Mendiola M. La evaluación del aprendizaje de los estudiantes. Revista Digital Universitaria, 2018;19(6).

- 7. Reisdorff J et al. Initial validity evidence for ABEM EMS Certification Examination. Prehospital Emergency Care, 2025;29(3):283-288.

- 8. Rubright D et al. Differential item functioning analysis of USMLE Step 1 items. Academic Medicine, 2022;97(5):718-722.

- 9. Kinnear B et al. Validity in the next era of assessment: Consequences, social impact, and equity. Perspectives on Medical Education, 2024;13(1):452-459.

- 10. Chudnofsky R et al. Early validity and reliability evidence for the ABEM Virtual Oral Examination. AEM Education and Training, 2023;7(2):e10850.

- 11. Dorsey W, Michaels R. Validity arguments meet artificial intelligence. Journal of Educational Measurement, 2022;59(3):267-271.